人工智能數學基礎(六) 常見數學函數與激活函數大全——構建人工智能基礎軟件的基石

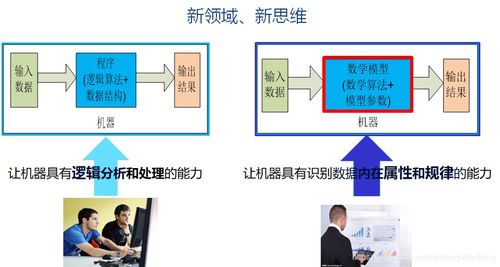

在人工智能(AI)的基礎開發中,數學是貫穿始終的靈魂,而各類數學函數,特別是神經網絡中的激活函數,則是構建智能模型的磚瓦。本文將系統梳理人工智能領域所需的核心數學函數,并重點匯編一份詳盡的激活函數大全,為AI基礎軟件開發提供理論支撐和實踐指引。

一、人工智能中的基礎數學函數

在AI模型(尤其是深度學習)的構建、訓練和優化過程中,以下幾類數學函數扮演著至關重要的角色:

- 線性函數:形式為

y = Wx + b。這是神經網絡每一層最基礎的變換,負責對輸入數據進行加權求和。權重W和偏置b是模型需要學習的關鍵參數。

- 指數與對數函數:

- 指數函數(如 exp(x)):在Softmax函數、某些激活函數(如ELU)及概率模型中廣泛應用。

- 對數函數(如 log(x)):是交叉熵損失函數的核心組成部分,用于衡量概率分布之間的差異,是分類任務中最常用的損失函數之一。

- 三角函數(如 sin, cos):在位置編碼(如Transformer模型中的正弦余弦編碼)、信號處理以及某些特定結構的網絡中有重要應用。

- 統計與概率函數:

- Softmax函數:將一組實數(通常是邏輯回歸值)轉換為概率分布,是多分類問題的標準輸出層函數。

- Sigmoid函數:本質上也是一個概率函數,將輸入映射到(0,1)區間,常用于二分類輸出層或表示概率。

- 高斯(正態)分布函數:在變分自編碼器(VAE)、高斯過程等概率生成模型中至關重要。

二、神經網絡激活函數大全

激活函數是神經網絡的“非線性引擎”,它決定了神經元是否被激活以及如何將輸入信號映射到輸出。沒有它,神經網絡將退化為線性模型,無法學習復雜模式。以下是對常見激活函數的系統性

(一)飽和激活函數(早期常用)

- Sigmoid (Logistic函數)

- 公式:

σ(x) = 1 / (1 + exp(-x))

- 值域:(0, 1)

- 優點:輸出平滑,易于解釋(可作為概率)。

- 缺點:容易導致梯度消失(在兩端飽和區梯度接近0);輸出不以0為中心,影響梯度下降效率;計算涉及指數,較慢。

- 主要應用:二分類輸出層。

- Tanh (雙曲正切函數)

- 公式:

tanh(x) = (exp(x) - exp(-x)) / (exp(x) + exp(-x))

- 值域:(-1, 1)

- 優點:輸出以0為中心,收斂速度通常比Sigmoid快。

- 缺點:同樣存在梯度消失問題。

- 主要應用:循環神經網絡(RNN)的隱藏層。

(二)非飽和激活函數(現代主流)

- ReLU (Rectified Linear Unit,整流線性單元)

- 公式:

f(x) = max(0, x)

- 優點:計算極其高效,解決了梯度消失問題(在正區間);收斂速度遠快于Sigmoid/Tanh。

- 缺點:“Dead ReLU”問題(負半軸梯度恒為0,導致部分神經元永久失活);輸出不以0為中心。

- 應用:最常用,是絕大多數卷積神經網絡(CNN)和全連接層的默認選擇。

- Leaky ReLU 及其變種

- 公式:

f(x) = max(αx, x),其中α是一個小的正數(如0.01)。

- 優點:解決了“Dead ReLU”問題,為負輸入提供了一個小的梯度α。

- 變種:Parametric ReLU (PReLU),將α作為可學習參數;Randomized ReLU (RReLU),在訓練時α隨機采樣。

- ELU (Exponential Linear Unit,指數線性單元)

- 公式:

f(x) = x (if x > 0) else α(exp(x)-1)

- 優點:輸出均值接近0,收斂更快;對噪聲更具魯棒性;解決了Dead ReLU問題。

- 缺點:計算涉及指數,稍慢于ReLU。

- Swish 函數 (由Google發現)

- 公式:

f(x) = x * sigmoid(βx),β可以是常數或可學習參數。

- 特點:平滑、非單調。在實踐中,尤其在深層模型上,有時表現優于ReLU。

- GELU (Gaussian Error Linear Unit,高斯誤差線性單元)

- 公式:

f(x) = x <em> Φ(x),其中Φ(x)是標準正態分布的累積分布函數。常用近似:0.5x </em> (1 + tanh[√(2/π)(x + 0.044715x^3)])

- 特點:在Transformer模型(如BERT, GPT)中廣泛采用,因其設計考慮了隨機正則化的效果,性能優異。

(三)輸出層專用函數

- Softmax:如前所述,用于多分類,將輸出歸一化為概率分布。

- Linear (恒等函數):用于回歸任務,輸出層直接輸出加權和。

三、在AI基礎軟件開發中的實踐指引

對于AI基礎軟件(如深度學習框架)的開發者和使用者,理解這些函數至關重要:

- 框架設計:優秀的AI框架(如PyTorch, TensorFlow)會在其核心庫(如

torch.nn.functional,tf.nn)中高效實現所有這些函數,并提供自動求導支持。 - 模型構建:開發者應根據任務類型選擇激活函數。一般原則:

- 隱藏層:優先使用 ReLU 及其變種(Leaky ReLU, GELU),它們是當前的最佳實踐起點。

- RNN隱藏層:可考慮 Tanh 或 ReLU。

- 輸出層:二分類用Sigmoid,多分類用Softmax,回歸用Linear。

- 性能調優:當使用ReLU遇到神經元“死亡”時,可嘗試Leaky ReLU或ELU。在非常深的網絡或Transformer中,GELU或Swish可能帶來增益。

- 自定義開發:研究人員有時需要為特定任務設計新的激活函數。基礎軟件應提供易于擴展的接口。

###

數學函數與激活函數是連接人工智能抽象理論與具體軟件實現的橋梁。從基礎的線性變換到復雜的非線性激活,它們共同賦予了神經網絡強大的表征學習能力。掌握這份“函數大全”并理解其背后的原理,是進行高效、創新的AI基礎軟件開發與應用的必備條件。隨著AI研究的深入,未來必將涌現出更多性能卓越、生物學可解釋性更強的新型函數,持續推動著整個領域向前發展。

最新產品

互補共生 邊緣計算與云基礎設施在AI基礎軟件開發中的協同價值

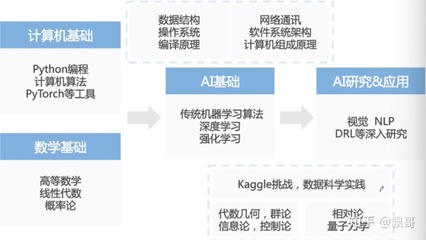

本科生人工智能學習路線 構建基礎軟件開發能力

英特爾數據中心級GPU 以高算力與多元化場景擊破AI與HPC中心高能耗迷局

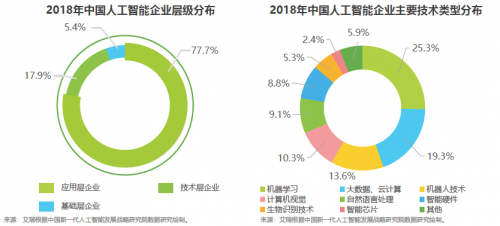

艾瑞中國AI產業研究報告發布 碼隆科技領跑新零售人工智能基礎軟件開發

人工智能教育應該包含哪些內容——優必學的探索與發現

《人工智能實驗教材 人工智能基礎軟件開發指南》

深度解析 人工智能基礎軟件開發的商業之路——現狀、潛力、障礙與風險

第四次工業革命浪潮下的掘金工具 華夏中證人工智能ETF投資價值分析

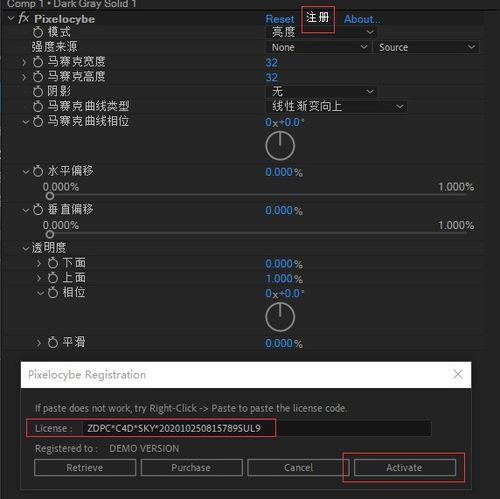

探索AI在創意工作流中的應用 從AE/PR自動人臉模糊插件到基礎軟件開發

人工智能導論第二章 數學基礎與人工智能軟件開發